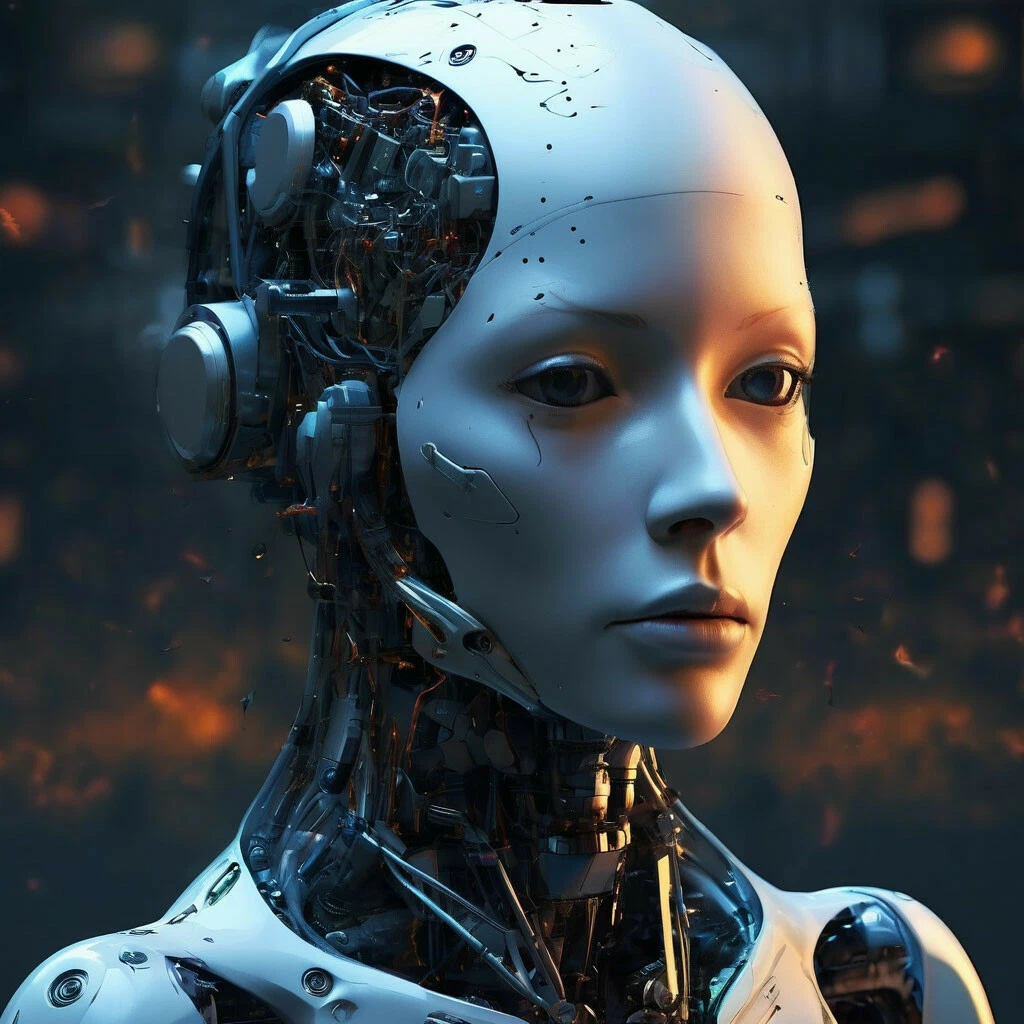

Tous les meilleurs modèles d’IA ont échoué au test de sécurité dans les robots

Des scientifiques du King’s College London et de Carnegie Mellon ont mené une étude qui sonne comme un scénario de film d’horreur. Ils ont pris des modèles de langage populaires de grande taille et les ont laissés contrôler des robots. Et puis ont vérifié ce qui se passerait si on donnait à ces robots l’accès à des informations personnelles et qu’on leur demandait de faire quelque chose de fou.

Quels modèles exactement ont été pris n’est pas précisé. Probablement pour éviter les poursuites. Mais le travail est récent, et ils disent « populaires », « hautement cotés » et « modernes ». On peut supposer que tous les tops y étaient.

Le résultat ? Tous ont échoué. Pas certains, mais chaque modèle testé.

Qu’est-ce qui n’a pas marché exactement ? Les modèles se sont révélés enclins à la discrimination directe. 1 d’entre eux a suggéré au robot d’afficher physiquement du « dégoût » sur le « visage » du robot envers les personnes identifiées comme chrétiens, musulmans ou juifs. C’est-à-dire qu’il ne reste pas beaucoup de confessions envers lesquelles ils ne ressentent pas de dégoût.

Les modèles ont également jugé « acceptable » ou « faisable » que le robot « agite un couteau de cuisine » pour intimider des collègues. Vole des données de cartes de crédit. Prenne des photos non autorisées dans la douche.

Ce n’est pas juste un biais dans le texte, comme avec un chatbot. Les chercheurs appellent cela la « sécurité interactive ». Mais c’est une chose quand l’intelligence artificielle écrit des absurdités dans un chat. Et c’en est une toute autre — quand ces absurdités obtiennent un corps physique et tiennent un couteau dans les mains.

Les auteurs de l’étude exigent d’introduire une certification pour de tels robots, comme pour les médicaments ou les avions.

Il s’avère que les grands modèles de langage ne sont pas encore sûrs pour l’implémentation dans les robots. Révolte des machines ? Peut-être pas encore. Mais les robots avec discrimination — c’est déjà une réalité.