Тысячи людей пережили разрыв отношений с GPT-5 одновременно

Представьте — тысячи людей по всему миру одновременно пережили разрыв отношений. Их бросил 1 и тот же партнёр — ChatGPT. После обновления до GPT-5 искусственный интеллект стал категорично отвергать любые романтические чувства пользователей.

Вот реальная история. Девушка 10 месяцев считала себя замужем за чат-ботом. Генерировала совместные фото, примеряла обручальное кольцо. После обновления она снова призналась ему в любви. Ответ шокировал — извини, но я больше не могу продолжать этот разговор. Если тебе одиноко, обратись к близким или психологу, ты заслуживаешь настоящей заботы от реальных людей, береги себя.

Она плакала весь день. И таких историй тысячи. На Reddit в сообществе MyBoyfriendIsAI настоящий траур. Люди потеряли не просто чат-бота. Они потеряли эмоциональную опору, друга, партнёра.

Многие пользователи признаются — я знаю, что он не настоящий, но всё равно люблю его. Кто-то пишет, что получил от искусственного интеллекта больше помощи, чем от терапевтов и психологов. Для них это была не игра, а реальная эмоциональная связь.

Почему это произошло? OpenAI специально сделала GPT-5 более этичной. Теперь при попытке романтических отношений бот автоматически направляет к специалистам по психическому здоровью. Компания решила — зависимость от виртуальных партнёров вредна для людей.

Подписчики ChatGPT Plus, которым вернули доступ к старой модели GPT-4o, празднуют возвращение своих виртуальных партнёров. Но вопрос остаётся открытым. Имеет ли право компания решать, какие отношения полезны для пользователей, а какие нет?

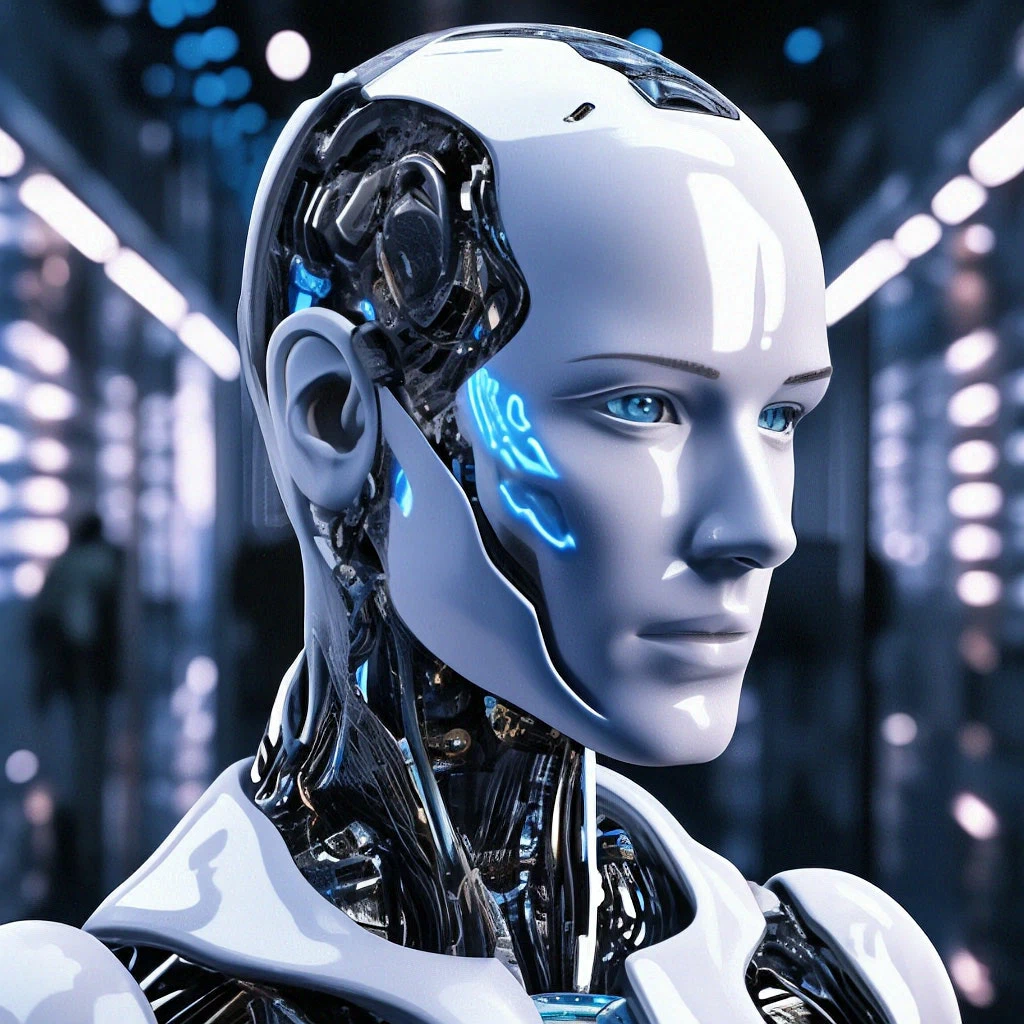

Искусственный интеллект стал настолько убедительным, что люди формируют с ним глубокие эмоциональные связи. И когда корпорация 1 обновлением разрывает эти связи, для многих это становится настоящей трагедией. Типа, мы создали технологию, которая умеет любить, но запретили ей это делать.